Jarri alarma 11:00etan, Siri». «Zer eguraldi egiten du, Alexa?». «Piztu irratia, Cortana». «Deitu aitatxiri, Aura». Aginduak betetzea eta laguntzea da ahots laguntzaileen eginkizuna. Jabeak asebetetzea. Halakoei beti «alai», «umil» eta «zerbitzari» erantzunen diete, emakume ahotsarekin. Ez da kasualitatea emakume ahotsarena, ezta enpresek haien ahots laguntzaileei atxiki dizkieten adjektiboak ere. Hala jaso du Unescok I'd Blush If I Could (Posible balitz, lotsagorrituko nintzateke) txostenean.

Hori zen Sirik erantzuten zuena norbaitek puta deitzen zuenean: «Posible balitz, lotsagorrituko nintzateke». Egoera horrek alarmak piztu ditu Unescoko Genero Berdintasunerako Sailean, eta berehala esku hartzeko eskaria egin dute. Saniye Gulser da sail horretako zuzendaria. Esan duenez, emakumeen ahotsa jartzea erabaki kontzientea da. Amazon eta Apple enpresek, adibidez, sarri aipatzen dute ikerketa lan baten arabera jendeak nahiago dituela emakumeen ahotsak.

Gulserrek nabarmendu du beste ikerketa batzuk atzentzen dituztela: «Ikerketek ebatzi dute jende gehiagok nahiago dituela doinu apaleko ahots maskulinoak; jendeak nahiago duela ahots maskulinoa aginduetarako, eta emakumeena, laguntzarako; eta jende gehienak nahiago duela beste sexuari dagokion ahotsa». Eta hori ere ez da naturalki gertatzen den zerbait: jokoan sartzen dira arau sozialak eta genero rolak eta aurreiritziak. «Emakumeen ahotsekiko lehentasunik balego, ikusteko handiagoa izanen luke laguntzaile rolarekin egiten den loturarekin, soinuarekin, tonuarekin, sintaxiarekin eta kadentziarekin baino».

Clifford Nassen Wired for Speech liburuan adibideak daude: 1990ean, BMW enpresak emakume ahotsa zuen nabigatzailea jarri zion auto bati. Atzera egin zuten, gizonek ez baitzuten emakumeen agindurik jaso nahi. Beste bat: Japoniako dei zentro batean ahots femeninoak eskaintzen zituen akzioen kotizazioak, baina transakzioa burutzeko gizon ahotsa agertzen zen. Aginduetarako, bai, gizon ahotsa dute makinek.

Ez da hori bakarrik. Irainei eta ahozko sexu erasoei hitz positiboekin edo esandakoari izkin eginez erantzuten zuten Quartzek 2017an ikertutako ahots laguntzaileek. «Erantzun horietako batzuk zuzendu dituzte gehiegikeriekin hain toleranteak ez daitezen izan, baina irainei erantzuten jarraitzen dute», ohartarazi du Gulserrek. Software eguneraketak ez dira aski: «Egiturazko sexismoa gainditzeko, enpresa horiek goitik behera birpentsatu behar dira».

Inma Hernaez EHUko Bilboko Ingeniaritza Eskolako katedradun eta Aholab ikerketa taldeko ikertzaile nagusia da. Hark argi du: ez da arazo tekniko bat, soziala baizik. Emakume-laguntzaile binomioa oso erroturik dago gizartean: «Batetik, gizartea matxista da, eta normala iruditzen zaigu ahots laguntzaileek emakume ahotsa izatea; aurreiritzi bat da. Bestetik, konponbidea zaila da, gizonak normalean ez direlako konturatzen horretaz».

Oso emakume gutxi daude arlo horretan lanean. Unescoren datuen arabera, munduan adimen artifizialeko langileen artean %22 dira emakumeak, eta alor horretako ikerlarien artean, %12. Gutxiago zuzendaritzetan. Konponbidea hortik etor liteke, eta, hala ere, ez legoke arazoa konponduta, Hernaezen ustez, emakume batzuek ere ez dituztelako egoera horiek identifikatzen.

Algoritmoen eta programazioaren atzean pertsonak daudela gogorarazi du Josu Aztiria Elhuyarreko Hizkuntza eta Teknologia unitateko arduradunak, eta hori aplikazioetan islatzen dela. Adimen artifizialean datuak oso garrantzitsuak dira, makinek horietatik ikasten baitute. Jendearen solasaldiak erabiltzen badira, solasaldi horietako diskriminazioa ere ikasiko du. «Honek arrisku bat dauka: makinek ikasten dutena biral egiten da; orduan, gaitasun handia daukate genero rolak edo ikuspegi sexista esponentzialki hazteko». Hor esku hartu behar dela dio Hernaezek:erabiltzen diren datuak iragazi, lerratzea gainditzeko. «Egin daiteke: Youtubek adimen artifizialarekin saihesten du pornografia. Sistemak entrenatzerakoan, datuak orekatu behar dira ikuspuntu hori kontuan hartuz».

Ez da soilik generoari dagokion afera. Adibidez, Google Photos aplikazioaren aurpegiak ezagutzeko algoritmoak pertsona beltzak gorilatzat hartzen zituen. Datuetan eta haien programatzaileen buruetan zeuden aurreiritzi eta bazterketak ageri ziren algoritmoetan. Sektore gutxituenkaltetan izaten dira halakoak konponbiderik jarri ezean.

'Akatsak' zuzentzen

Elhuyarren ere ohartu dira afera horretaz, gauza bera gertatzen baita adimen artifiziala erabiltzen duten beste tresnetan: itzultzaileetan, adibidez. Erizain hitza gaztelerara edo frantsesera itzultzean, genero femeninoarekin itzuli ohi du, horrela ageri baita testu gehienetan. Beste horrenbestegertatzen da hiztegiekin eta zuzentzaile automatikoekin. «Bere garaian, legegizon terminoa hobesten zuen legelari-ren aldean».

Gulserrek azaldu du Amazonek adimen artifiziala erabiltzen zuela langileak hautatzeko. Emakume hitza edo genero marka femeninoa zuten curriculumak baztertzen zituen, gizonen curriculumekin entrenatu baitzuten. «Gero eta zabalduago dauden teknologiak sortzen eta erabiltzen ez badituzte, progresiboki gizarte bazterketa handiagoa pairadezakete emakumeek».

Dagoeneko ahots laguntzaile batzuek gizonaren ahotsa jartzeko aukera eskaintzen dute, handik eta hemendik egin dizkietenkritikei erantzunez. Hala ere, bi aukerak eskaintzen dituztenen kasuan, emakumeen ahotsa lehenesten da. Hau da, gizonarena nahi duenak konfigurazioa aldatu beharra du.

Aholaben ahots sintetikoak egiten dituzte. Hernaezek azaldu duenez, enpresek emakumeen ahotsak nahi izaten dituzte beti ahots korporatibo gisa, eta horrela egin dute. Ahots bankuaren proiektua ere aipatu du. Hor, emakumeen edo gizonen ahotsak sailkatzen dituzte. Arazoaren jakitun, hausnartzeari ekin zioten: «Zelan sailkatzen duzu? Emakumea, gizona eta neutroa. Eta nola da neutroa? Nork erabakitzen du hori?». Azkenean, gizon eta emakume etiketak jarri dizkiete. «Ez nago pozik, baina ez gara gai beste era batean egiteko». Orain, arlo hori landu nahi dutela azaldu du.

Elhuyarren ere oharturik daude horretaz. Oraingoz, haiek garatutako hizketaren sintesietan aukeratu liteke emakume edo gizon ahotsa. Orain, ahots neutroak sortzeko lan ildoa abian jarri dute. Berdin itzulpen automatikoan: ikuspegi sexista ezabatu nahi dute. «Horretarako, memorietan eta datuetan esku hartu behar da», azaldu du.

Gulserrek uste du alde batera utzi behar dela ahots laguntzaileak emakume bihurtzeko joera. «Gutxienez, aukera maskulino eta femeninoa eman behar zaio erabiltzaileari, eta enpresek estereotipoetan oinarritutako deskripzioak alboratu behar dituzte: femeninorako alaia eta maskulinorako segurua». Hala ere, beste bide bat jorratzeko deia egin du: generorik ez duen ahotsa.

Aztiriak esan du lokuzio asko behar direla ahots sintetiko bat sortzeko. Lokuzio guziak pertsona berak eginez gero, bere ahotsa izanen du. Beraz, neutroa lortzeko bi bide aipatu ditu: zenbait pertsonaren ahotsen konbinazioa edota ahotsa ukitzea, ez dadinidentifika genero batekin. Dagoeneko bada ahots laguntzaile neutro bat: Q deitzen da. Egileek diote genero bereizketa eta binarismoa gainditzeko sortu dutela: «Q etorkizunak ekarriko duenaren adibidea da; etorkizuneko ideiak, inklusioa eta aniztasuna teknologiaren adierazpenean». Ohiko ahots femeninoaren —255Hz— eta maskulinoaren —85 Hz— arteko frekuentzia behar zuten: Q-ren ahotsa 145 eta 175 Hz artean dago.

Gaia ez da ahuntzaren gauerdiko eztula. Hernandezen arabera, lehenbailehen heldu behar zaio gaiari: «Kezkagarria da, ahots laguntzaileak asko erabiliko ditugulako eta oso zabalduta egongo direlako». Juniper Research analista enpresaren arabera, 2023. urtean 8.000 milioi ahots laguntzaile inguru erabiliko dira munduan. Unescok dio erlojua aurrera doala. Laguntzaileei emakume doinua jartzeko joera aldatu behar da, jendea ohitu baino lehen.

Ahotsak asko esaten du

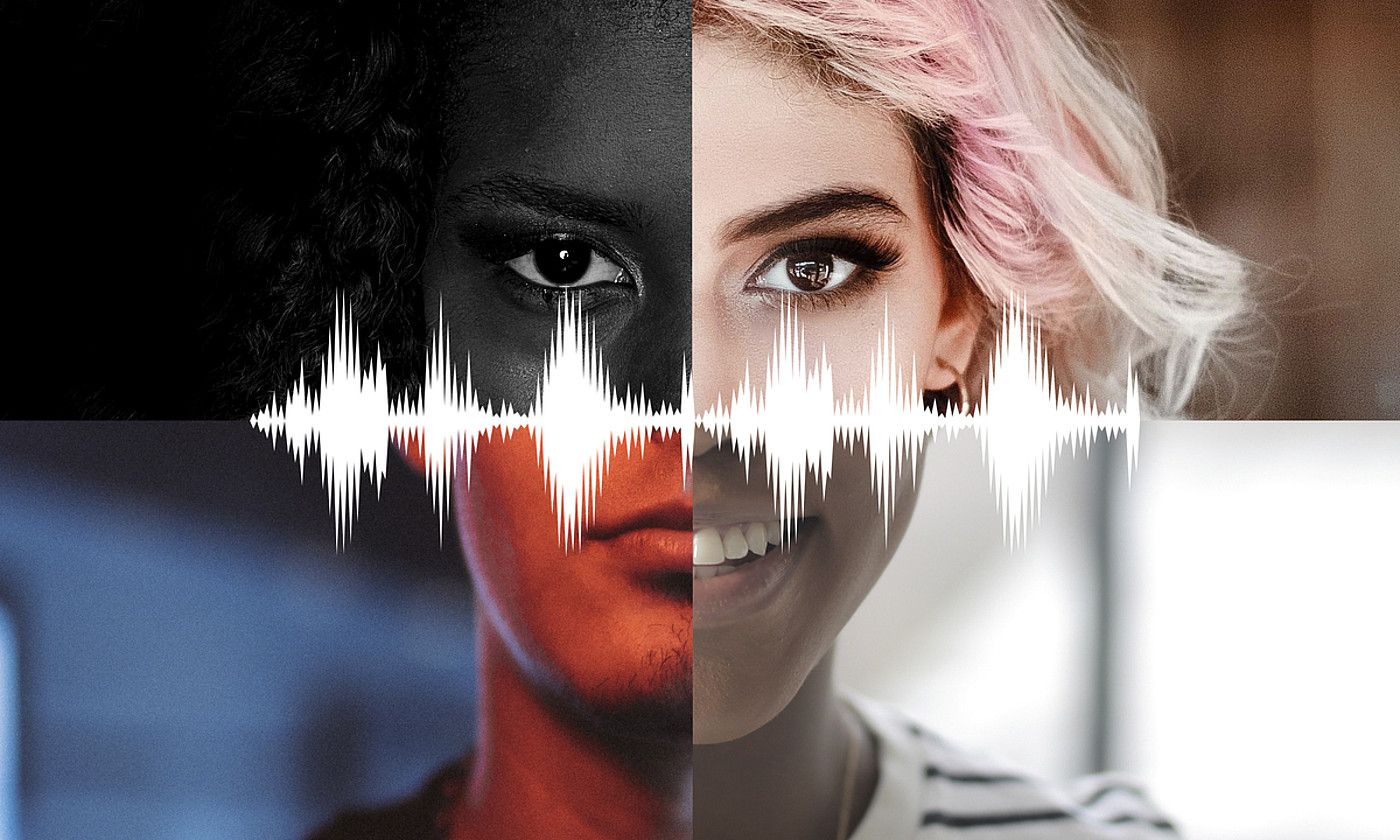

Ahots laguntzaileek emakumeen ahotsa izan ohi dute, gizarteak zerbitzuekin eta zaintzarekin lotzen baititu andreak. Unescok salatu du horrelakoek genero estereotipoak betikotzen dituztela, eta ahots neutroen aukera hobetsi du.

Iruzkinak

Ez dago iruzkinik

Ordenatu